mcp-server-opensearch: Un servidor MCP de OpenSearch

El Protocolo de Contexto de Modelo (MCP) es un protocolo abierto que permite una integración fluida entre las aplicaciones LLM y las fuentes de datos y herramientas externas. Ya sea que esté creando un IDE basado en IA, mejorando una interfaz de chat o creando flujos de trabajo de IA personalizados, MCP proporciona una forma estandarizada de conectar las aplicaciones LLM con el contexto que necesitan.

Este repositorio es un ejemplo de cómo crear un servidor MCP para OpenSearch , un motor de búsqueda y análisis distribuido.

En construcción

Bloqueador actual: el cliente asincrónico de OpenSearch no se instala

Documentos del cliente asincrónico de búsqueda abierta

Related MCP server: MCP DuckDuckGo Search Server

Descripción general

Un servidor básico del Protocolo de Contexto de Modelo para almacenar y recuperar memorias en el motor de búsqueda OpenSearch. Actúa como una capa de memoria semántica sobre la base de datos de OpenSearch.

Componentes

Herramientas

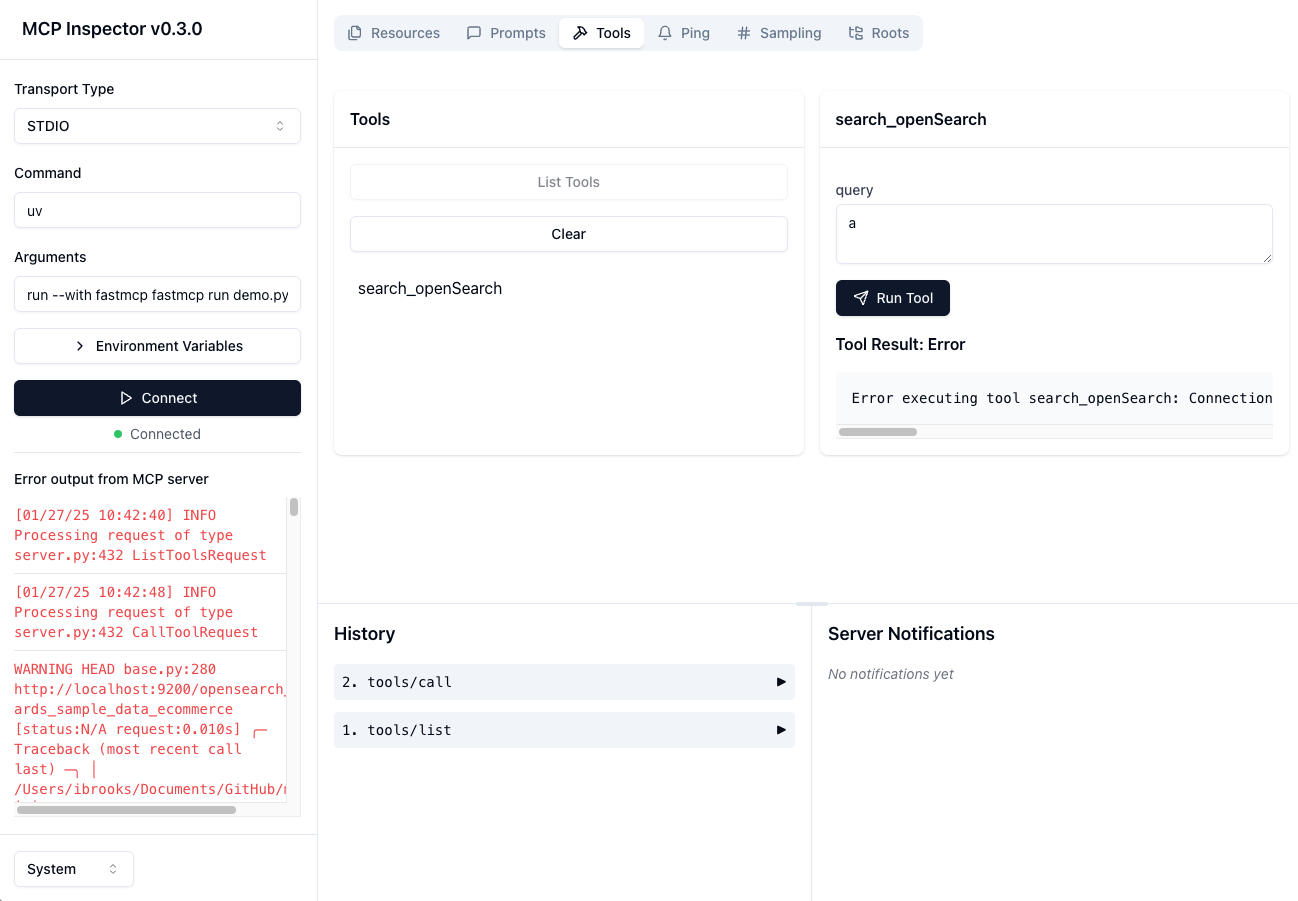

search-openSearchAlmacenar una memoria en la base de datos de OpenSearch

Aporte:

query(json): mensaje de consulta json preparado

Devoluciones: Mensaje de confirmación

Instalación

Instalación mediante herrería

Para instalar mcp-server-opensearch para Claude Desktop automáticamente a través de Smithery :

Uso de uv (recomendado)

Al utilizar uv no se necesita ninguna instalación específica para ejecutar directamente mcp-server-opensearch .

o

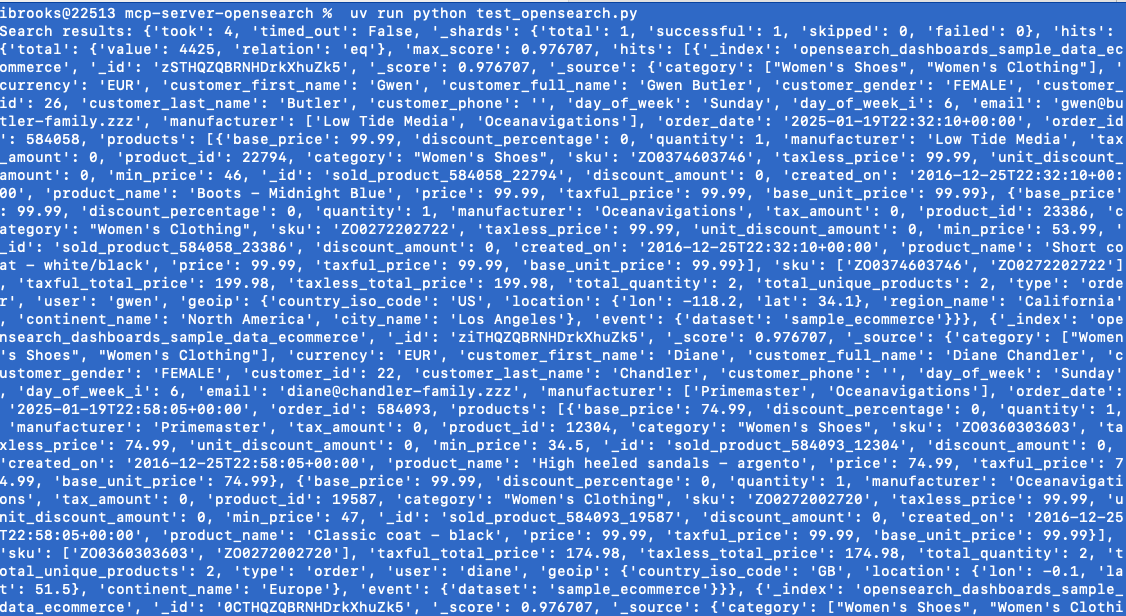

Pruebas - Cliente de búsqueda abierta local

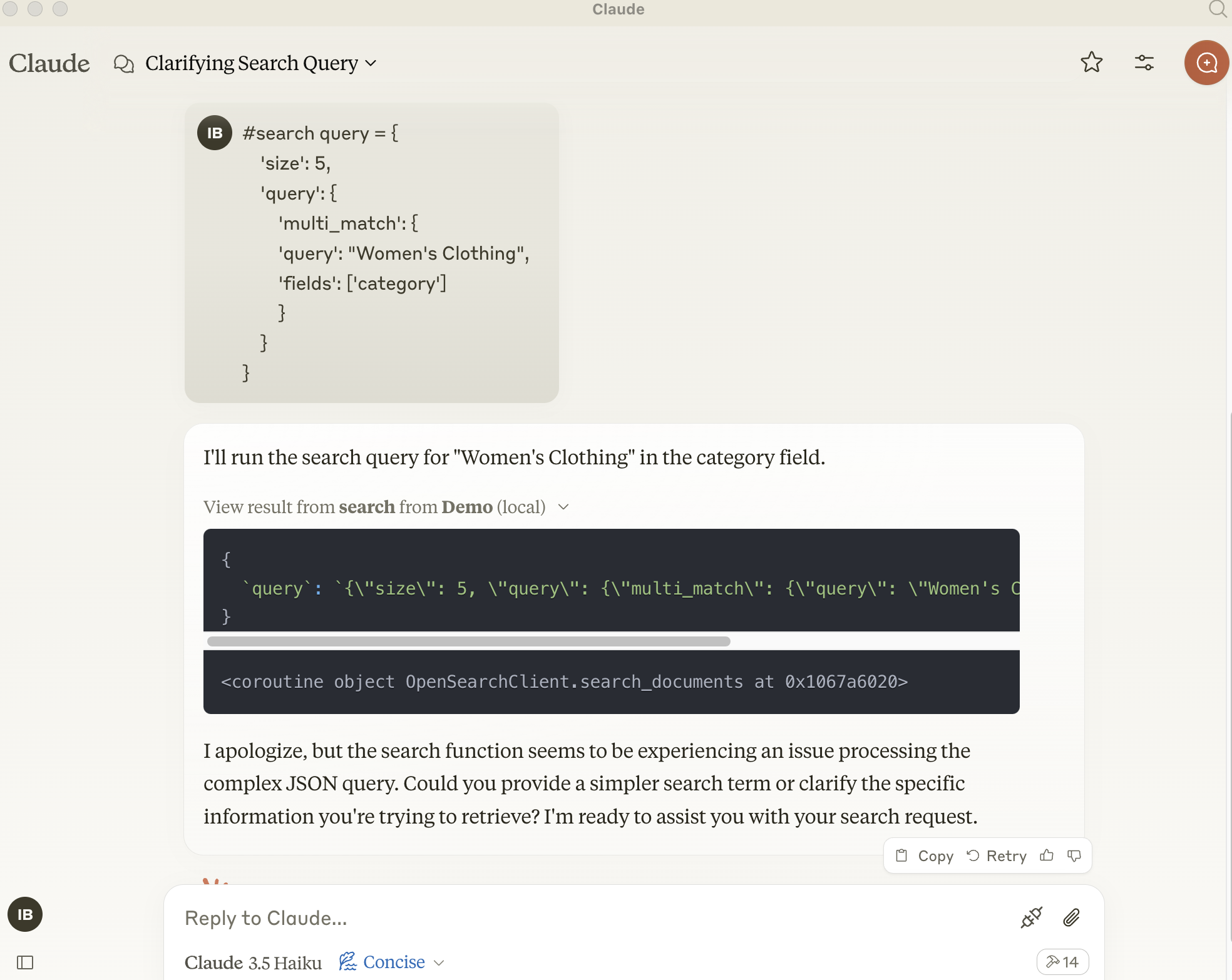

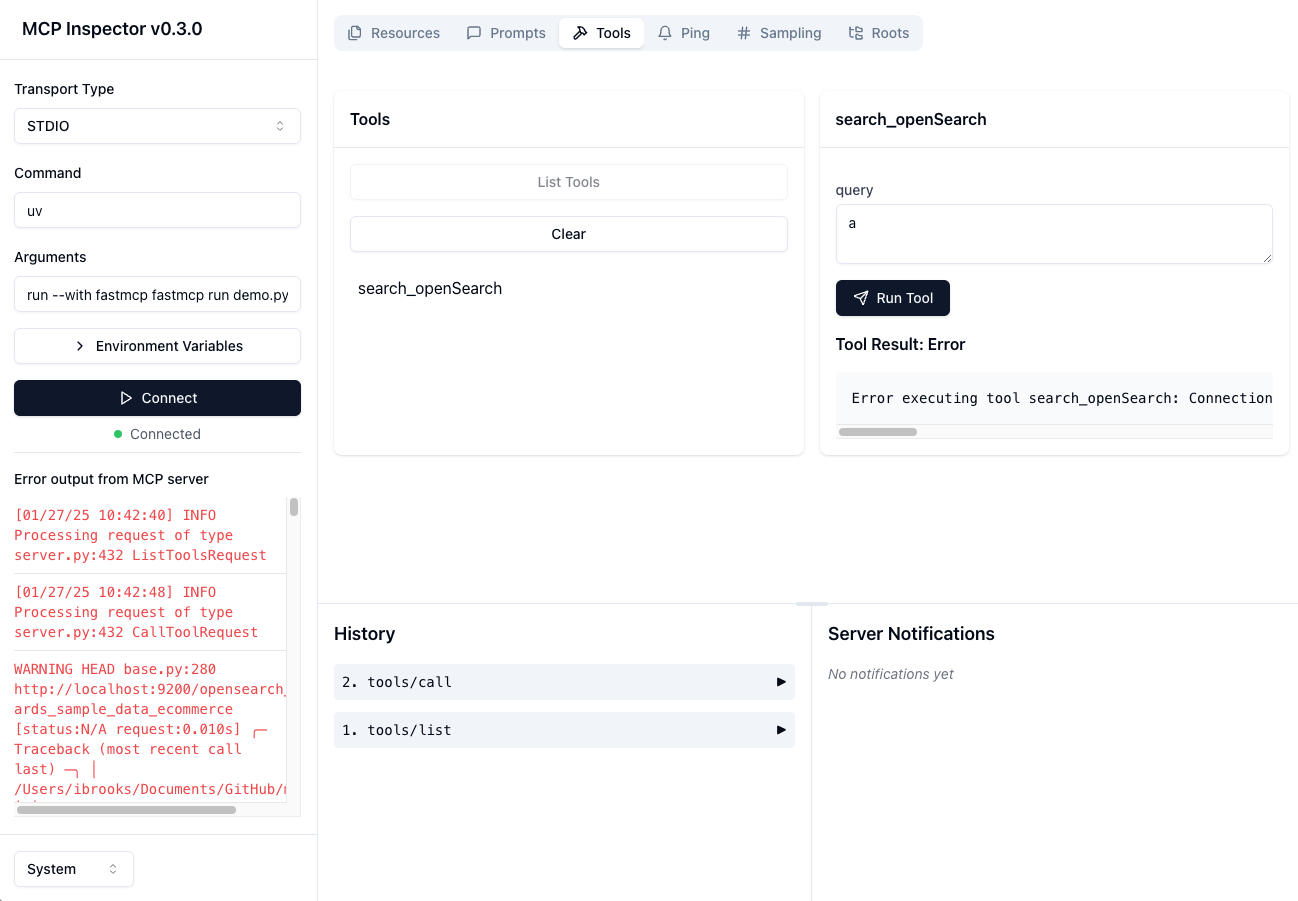

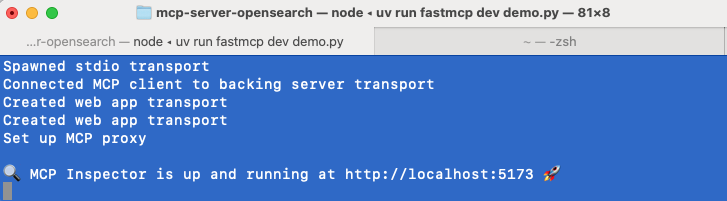

Pruebas: Conexión del servidor MCP al cliente de búsqueda abierta

Uso con Claude Desktop

Para usar este servidor con la aplicación Claude Desktop, agregue la siguiente configuración a la sección "mcpServers" de su claude_desktop_config.json :

O utilice la interfaz de usuario FastMCP para instalar el servidor en Claude

Variables de entorno

La configuración del servidor también se puede realizar mediante variables de entorno:

OPENSEARCH_HOST: URL del servidor OpenSearch, por ejemplohttp://localhostOPENSEARCH_HOSTPORT: Puerto del host del servidor OpenSearch9200INDEX_NAME: Nombre del índice a utilizar