MCPHub:模型上下文协议 (MCP) 服务器的统一中心

English |中文版

MCPHub 通过将多个 MCP(模型上下文协议)服务器组织成灵活的可流式 HTTP(SSE)端点(支持访问所有服务器、单个服务器或逻辑服务器组),可以轻松管理和扩展多个 MCP(模型上下文协议)服务器。

🚀 功能

扩大 MCP 服务器支持:以最少的配置无缝集成任何 MCP 服务器。

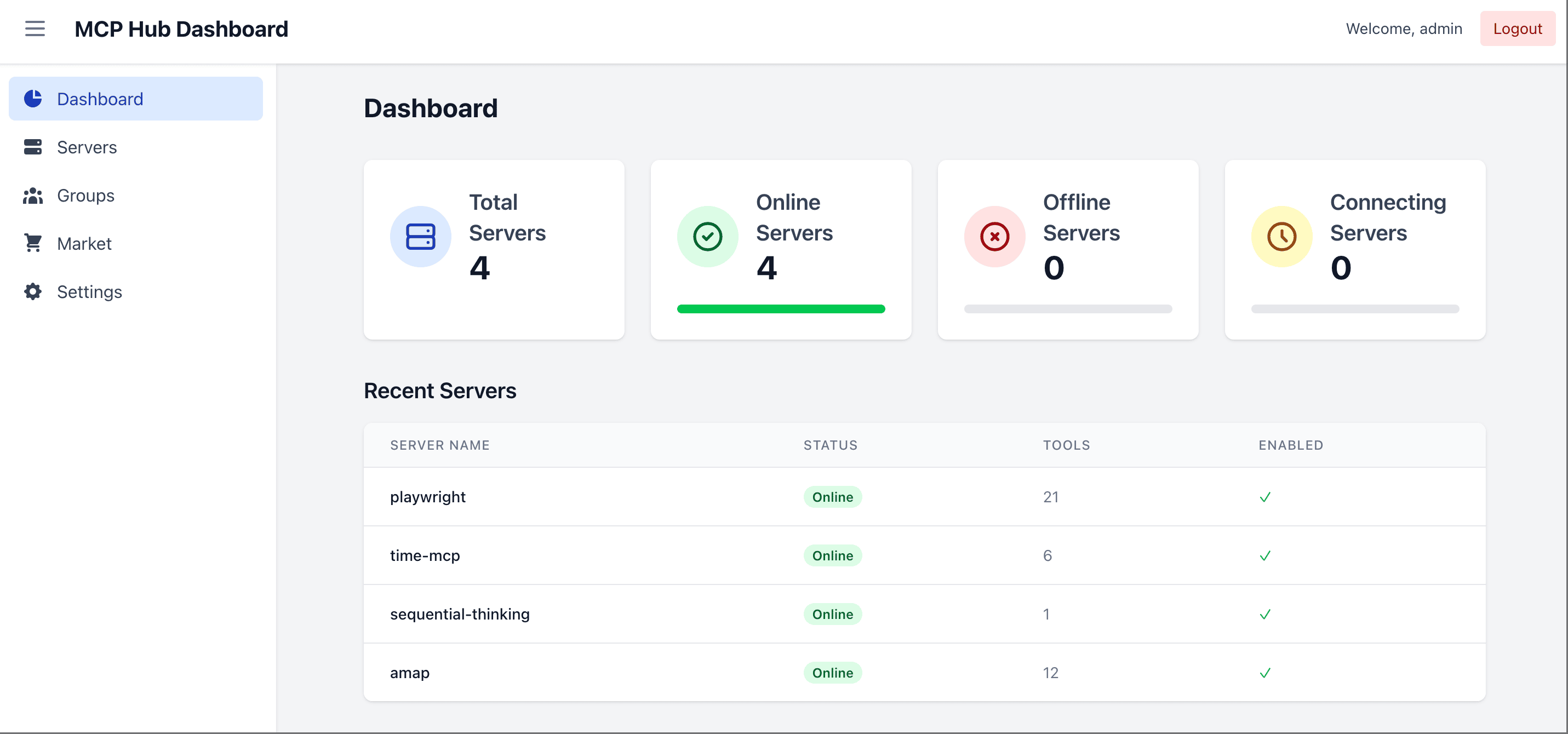

集中式仪表板:从一个简洁的 Web UI 监控实时状态和性能指标。

灵活的协议处理:与 stdio 和 SSE MCP 协议完全兼容。

热插拔配置:动态添加、删除或更新 MCP 服务器 — 无需停机。

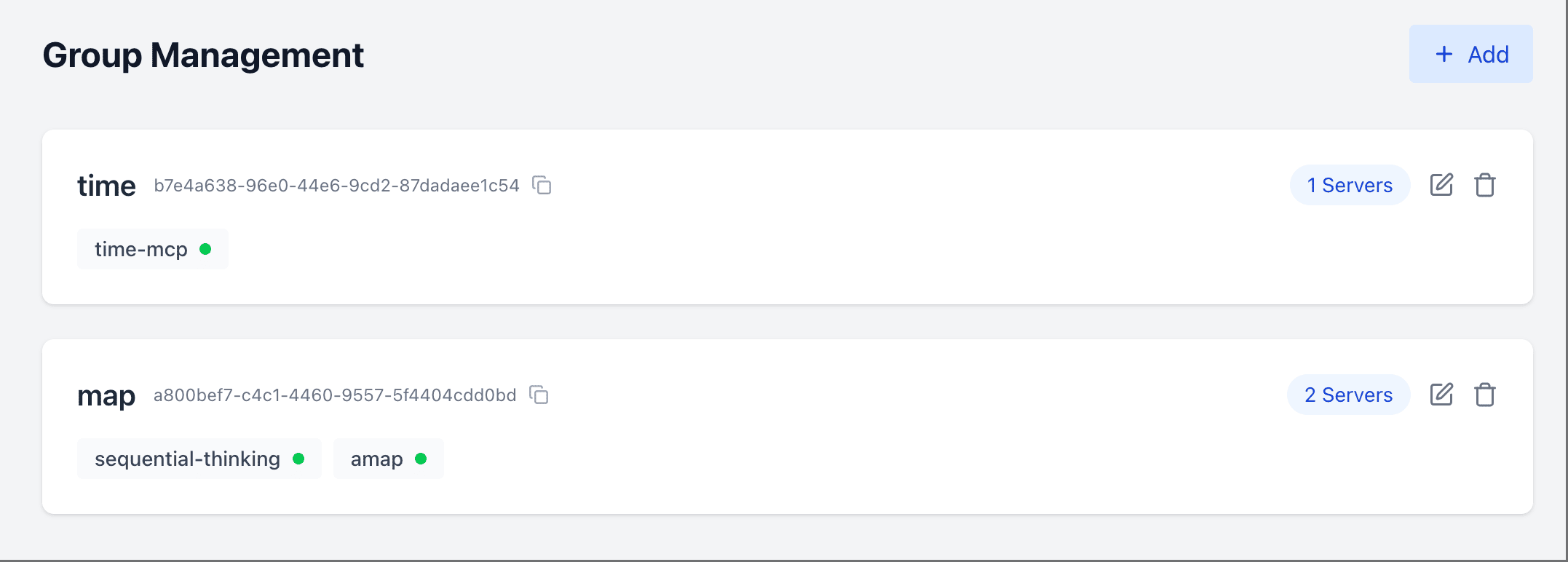

基于组的访问控制:将服务器组织成可定制的组,以简化权限管理。

安全身份验证:内置用户管理,具有由 JWT 和 bcrypt 支持的基于角色的访问。

Docker-Ready :使用我们的容器化设置立即部署。

Related MCP server: GitHub Repos Manager MCP Server

🔧 快速入门

可选配置

创建mcp_settings.json文件来自定义您的服务器设置:

Docker 部署

推荐:安装您的自定义配置:

或使用默认设置运行:

访问仪表板

打开http://localhost:3000并使用您的凭据登录。

注意:默认凭据是

admin/admin123。

仪表板概述:

所有 MCP 服务器的实时状态

启用/禁用或重新配置服务器

用于组织服务器的组管理

用于访问控制的用户管理

可流式传输的 HTTP 端点

截至目前,不同的 AI 客户端对流式 HTTP 端点的支持有所不同。如果您遇到问题,可以使用 SSE 端点或等待后续更新。

通过以下方式连接 AI 客户端(例如 Claude Desktop、Cursor、DeepChat 等):

此端点为您的所有 MCP 服务器提供统一的可流式传输的 HTTP 接口。它允许您:

向任何已配置的 MCP 服务器发送请求

实时接收回复

轻松与各种AI客户端和工具集成

对所有服务器使用相同的端点,简化集成过程

特定组端点(推荐) :

对于特定服务器组的目标访问,请使用基于组的 HTTP 端点:

其中{group}是您在信息中心中创建的组的 ID 或名称。这允许您:

连接到按用例组织的特定 MCP 服务器子集

隔离不同的AI工具以仅访问相关服务器

针对不同的环境或团队实施更细粒度的访问控制

特定于服务器的端点:要直接访问单个服务器,请使用特定于服务器的 HTTP 端点:

其中{server}是您要连接的服务器名称。这允许您直接访问特定的 MCP 服务器。

注意:如果服务器名称和组名相同,则组名优先。

SSE 端点(未来将弃用)

通过以下方式连接 AI 客户端(例如 Claude Desktop、Cursor、DeepChat 等):

对于特定服务器组的目标访问,请使用基于组的 SSE 端点:

要直接访问单个服务器,请使用特定于服务器的 SSE 端点:

🧑💻 本地开发

这将以热重载的方式在开发模式下启动前端和后端。

对于 Windows 用户,您可能需要分别启动后端服务器和前端:

pnpm backend:dev,pnpm frontend:dev。

🛠️常见问题

使用 Nginx 作为反向代理

如果您使用 Nginx 反向代理 MCPHub,请确保在 Nginx 设置中添加以下配置:

🔍 技术栈

后端:Node.js、Express、TypeScript

前端:React、Vite、Tailwind CSS

授权:JWT 和 bcrypt

协议:模型上下文协议 SDK

👥 贡献

欢迎任何形式的贡献!

新功能和优化

文档改进

错误报告和修复

翻译和建议

欢迎加入我们的Discord 社区进行讨论和支持。

❤️ 赞助商

如果你喜欢这个项目,也许你可以考虑:

🌟 明星历史

📄 许可证

根据Apache 2.0 许可证授权。