インタラクティブフィードバックMCP

ファビオ・フェレイラ ( @fabiomlferreira ) によって開発されました。 AI 開発の拡張機能の詳細については、 dotcursorrules.com をチェックしてください。

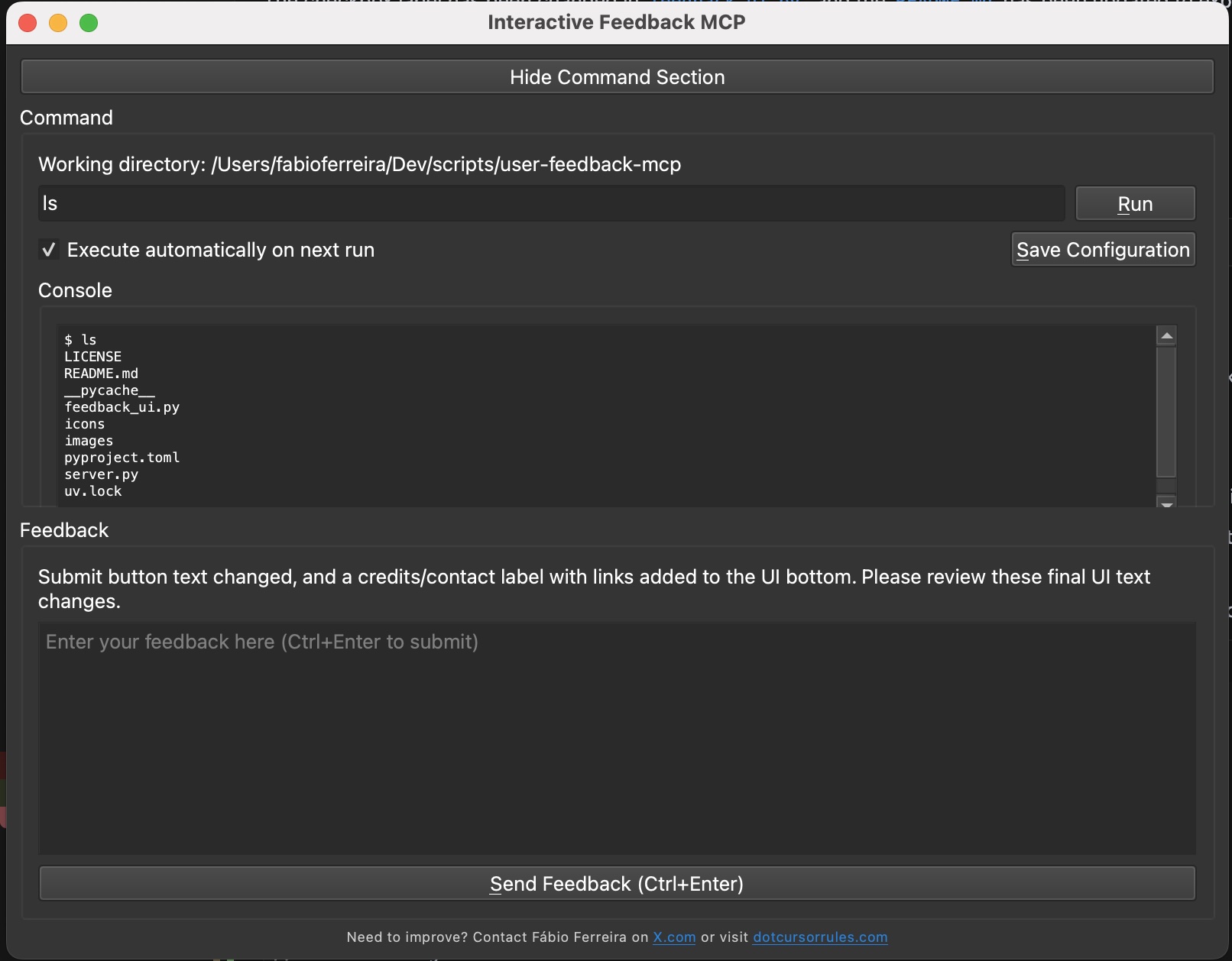

CursorのようなAI支援開発ツールにおいて、人間参加型ワークフローを実現するシンプルなMCPサーバー。このサーバーでは、コマンドの実行、出力の確認、そしてAIへのテキストフィードバック直接提供が可能です。Cline およびWindsurfとも互換性があります。

プロンプトエンジニアリング

最良の結果を得るには、AI アシスタントのカスタム プロンプトに次のコードを追加します。ルールに追加するか、プロンプトに直接追加する必要があります (例: カーソル)。

質問がある場合は、必ず MCP

interactive_feedbackを呼び出してください。

ユーザーリクエストを完了しようとするときは、単にプロセスを終了するのではなく、MCPinteractive_feedbackを呼び出します。フィードバックが空の場合は、リクエストを終了し、ループ内で MCP を呼び出さないでください。

これにより、AI アシスタントは、タスクを完了としてマークする前に、この MCP サーバーを使用してユーザーからのフィードバックを要求するようになります。

Related MCP server: Interactive Feedback MCP

💡 なぜこれを使うのですか?

このモジュールは、アシスタントが投機的でコストの高いツール呼び出しに分岐するのではなく、ユーザーと連絡を取るように誘導することで、Cursorのようなプラットフォームにおけるプレミアムリクエスト(例:OpenAIツールの呼び出し)の数を大幅に削減できます。場合によっては、最大25回のツール呼び出しを単一のフィードバックを考慮したリクエストに統合することで、リソースを節約し、パフォーマンスを向上させます。

構成

このMCPサーバーは、QtのQSettingsを使用してプロジェクトごとに設定を保存します。これには以下が含まれます。

実行するコマンド。

そのプロジェクトの次回の起動時にコマンドを自動的に実行するかどうか (「次回実行時に自動的に実行」チェックボックスを参照)。

コマンド セクションの表示状態 (表示/非表示) (切り替えるとすぐに保存されます)。

ウィンドウの形状と状態 (一般的な UI 設定)。

これらの設定は通常、組織名「FabioFerreira」およびアプリケーション名「InteractiveFeedbackMCP」で、プラットフォーム固有の場所 (Windows の場合はレジストリ、macOS の場合は plist ファイル、Linux の場合は~/.configまたは~/.local/share内の構成ファイルなど) に保存され、プロジェクト ディレクトリごとに一意のグループが作成されます。

UI の「設定を保存」ボタンは、主にコマンド入力フィールドに入力された現在のコマンドと、アクティブなプロジェクトの「次回実行時に自動実行」チェックボックスの状態を保存します。コマンドセクションの表示/非表示は、切り替え時に自動的に保存されます。ウィンドウの一般的なサイズと位置は、アプリケーションを終了する際に保存されます。

インストール(カーソル)

前提条件:

Python 3.11 以降。

uv (Python パッケージマネージャー)。次のコマンドでインストールします。

Windows:

pip install uvLinux/Mac:

curl -LsSf https://astral.sh/uv/install.sh | sh

コードを取得:

このリポジトリをクローンします:

git clone https://github.com/noopstudios/interactive-feedback-mcp.gitまたは、ソースコードをダウンロードしてください。

次のディレクトリに移動します:

cd path/to/interactive-feedback-mcp

依存関係をインストールします:

uv sync(仮想環境を作成し、パッケージをインストールします)

MCP サーバーを実行します。

uv run server.py

カーソルで設定:

Cursor は通常、設定でカスタム MCP サーバーを指定できます。Cursor をこの実行中のサーバーに指定する必要があります。具体的な方法は異なる場合がありますので、カスタム MCP の追加については Cursor のドキュメントを参照してください。

手動構成 (例:

/Users/fabioferreira/Dev/scripts/interactive-feedback-mcp{ "mcpServers": { "interactive-feedback-mcp": { "command": "uv", "args": [ "--directory", "/Users/fabioferreira/Dev/scripts/interactive-feedback-mcp", "run", "server.py" ], "timeout": 600, "autoApprove": [ "interactive_feedback" ] } } }Cursor で設定するときに、

interactive-feedback-mcpのようなサーバー識別子を使用する場合があります。

クライン/ウィンドサーフィン用

同様の設定原則が適用されます。各ツールのMCP設定で、サーバーコマンド(例: uv run server.pyにプロジェクトディレクトリを指す正しい--directory引数を指定)を設定し、サーバー識別子としてinteractive-feedback-mcpを使用します。

発達

テスト用の Web インターフェースを使用して開発モードでサーバーを実行するには:

これにより、Web インターフェイスが開き、テスト用の MCP ツールを操作できるようになります。

利用可能なツール

AI アシスタントがinteractive_feedbackツールを呼び出す例を次に示します。

謝辞と連絡先

このインタラクティブ フィードバック MCP が役に立つと思われる場合は、 X @fabiomlferreiraで Fábio Ferreira をフォローして感謝の気持ちを表すのが最適です。

ご質問やご提案がある場合、または使用方法を共有したい場合は、お気軽に X までご連絡ください。

また、AI 支援開発ワークフローを強化するための詳細なリソースについては、 dotcursorrules.com をご覧ください。